على مدى الأشهر القليلة الماضية، اشتعل مجتمع الذكاء الاصطناعي بنقاش ساخن أثارته ورقتان بحثيتان مؤثرتان نشرتهما شركة أبل. الأول، " وهم التفكير-وهم التفكير-هذا النقاش الذي يهز عالم الذكاء الاصطناعي&_bhlid=a540c17e5de7c2723906dabd9bd9b8b8f31cdf0c0c5bf18" target="_blank" id="">"GSM-Symbolic" (أكتوبر 2024)، والثاني "وهم التفكير" (يونيو 2025)، شكك في القدرات المنطقية المزعومة لنماذج اللغات الكبيرة، مما أثار ردود فعل متباينة في جميع أنحاء الصناعة.

كما تم تحليله بالفعل في دراستنا السابقة حول "وهم التقدم: محاكاة الذكاء الاصطناعي العام دون الوصول إليه"، فإن مسألة التفكير الاصطناعي تمس جوهر ما نعتبره ذكاءً في الآلات.

أجرى باحثو شركة Apple تحليلاً منهجياً على نماذج الاستدلال الكبيرة (LRM) - تلك النماذج التي تولد آثاراً تفصيلية للتفكير قبل تقديم إجابة. كانت النتائج مفاجئة ومقلقة للكثيرين.

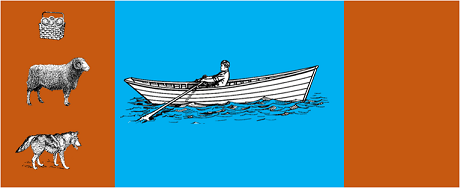

أخضعت الدراسة النماذج الأكثر تقدمًا للألغاز الخوارزمية الكلاسيكية مثل:

أظهرت النتائج أنه حتى التغييرات الطفيفة في صياغة المشكلة تؤدي إلى اختلافات كبيرة في الأداء، مما يشير إلى هشاشة مقلقة في التفكير. كما ورد في تغطية AppleInsider"ينخفض أداء جميع النماذج عندما يتم تغيير القيم العددية فقط في الأسئلة المعيارية GSM-Symbolic".

لم يتأخر الرد من مجتمع الذكاء الاصطناعي. فقد نشر أليكس لوسن من مؤسسة Open Philanthropy، بالتعاون مع كلود أوبوس من مؤسسة Anthropic، ردًا مفصلاً بعنوان "وهم التفكير".يطعن في منهجيات واستنتاجات دراسة Apple.

عندما كرر لوسن الاختبارات بمنهجيات بديلة - حيث طلب من النماذج توليد دوال تكرارية بدلاً من سرد جميع الحركات - كانت النتائج مختلفة بشكل كبير. قامت نماذج مثل Claude و gemini و GPT بحل مشاكل برج هانوي بشكل صحيح مع 15 سجلاً، وهو ما يتجاوز بكثير التعقيد الذي أبلغت فيه Apple عن عدم وجود أي نجاحات.

غاري ماركوسوهو ناقد قديم لمهارات الاستدلال لدى طلبة الماجستير في القانون (LLMs)، تبنى نتائج شركة Apple كتأكيد لأطروحته التي استمرت 20 عاماً. فوفقاً لماركوس، لا يزال طلاب الماجستير في القانون يعانون من "التحول في التوزيع" - أي القدرة على التعميم خارج نطاق بيانات التدريب - بينما يظلون "بارعين في حل المشاكل التي تم حلها بالفعل".

امتد النقاش أيضًا إلى مجتمعات متخصصة مثل LocalLlama على موقع Redditحيث يناقش المطورون والباحثون الآثار العملية المترتبة على النماذج مفتوحة المصدر والتنفيذ المحلي.

هذا النقاش ليس أكاديميًا بحتًا. فله آثار مباشرة على:

كما هو موضح في العديد من الرؤى التقنيةهناك حاجة متزايدة لمقاربات هجينة تجمع بين

مثال بسيط: مساعد ذكاء اصطناعي يساعد في مسك الدفاتر. يفهم نموذج اللغة عندما تسأل "كم أنفقت على السفر هذا الشهر؟" ويستخرج المعلمات ذات الصلة (الفئة: السفر، الفترة: هذا الشهر). لكن استعلام SQL الذي يستعلم عن قاعدة البيانات ويحسب المجموع ويتحقق من القيود المالية؟ يتم ذلك بواسطة كود حتمي، وليس النموذج العصبي.

لم يغب عن بال المراقبين أن ورقة أبل نُشرت قبل فترة وجيزة من نشر WWDC، مما أثار تساؤلات حول الدوافع الاستراتيجية. كما جاء فيتحليل 9to5Mac"أثار توقيت ورقة آبل البحثية - قبل مؤتمر WWDC مباشرةً - بعض التساؤلات. هل كان هذا حدثاً بحثياً بارزاً أم خطوة استراتيجية لإعادة تموضع أبل في مشهد الذكاء الاصطناعي الأوسع؟

يذكرنا النقاش الذي أثارته أوراق آبل بأننا ما زلنا في المراحل الأولى من فهم الذكاء الاصطناعي. كما أشرنا في مقالنا السابقفإن التمييز بين المحاكاة والاستدلال الحقيقي لا يزال أحد أكثر التحديات تعقيدًا في عصرنا الحالي.

لا تكمن العبرة الحقيقية في ما إذا كانت أدوات الذكاء الاصطناعي المحلية قادرة على "التفكير" بالمعنى الإنساني للمصطلح أم لا، بل في كيفية بناء أنظمة تستغل نقاط قوتها مع تعويض أوجه القصور فيها. في عالم يُحدث فيه الذكاء الاصطناعي بالفعل تحولاً في قطاعات بأكملها، لم يعد السؤال المطروح هو ما إذا كانت هذه الأدوات "ذكية" أم لا، بل كيف يمكن استخدامها بفعالية ومسؤولية.

من المحتمل ألا يكمن مستقبل الذكاء الاصطناعي للمؤسسات في نهج ثوري واحد، ولكن في التنسيق الذكي للعديد من التقنيات التكميلية. وفي هذا السيناريو، تصبح القدرة على التقييم النقدي والصادق لقدرات أدواتنا ميزة تنافسية بحد ذاتها.

آخر التطورات (يناير 2026)

OpenAI تطلق o3 و o4-mini: في 16 أبريل 2025، أطلقت OpenAI علنًا o3 و o4-mini، وهما أكثر نماذج الاستدلال تقدمًا في سلسلة o. يمكن لهذه النماذج الآن استخدام الأدوات بطريقة فعالة، حيث تجمع بين البحث على الويب وتحليل الملفات والاستدلال البصري وتوليد الصور. حقق o3 أرقامًا قياسية جديدة في معايير مثل Codeforces و SWE-bench و MMMU، بينما يعمل o4-mini على تحسين الأداء والتكاليف لمهام الاستدلال عالية الحجم. تظهر النماذج قدرات "التفكير بالصور"، حيث تقوم بتحويل المحتوى بصريًا لإجراء تحليلات أكثر تعمقًا.

DeepSeek-R1 تهز صناعة الذكاء الاصطناعي: في يناير 2025، أطلقت DeepSeek نموذج R1، وهو نموذج استدلال مفتوح المصدر حقق أداءً مماثلاً لـ OpenAI o1 بتكلفة تدريب بلغت 6 ملايين دولار فقط (مقارنة بمئات الملايين من النماذج الغربية). يثبت DeepSeek-R1 أن قدرات الاستدلال يمكن تحفيزها من خلال التعلم المعزز البحت، دون الحاجة إلى عروض بشرية مذيلة بتعليقات. أصبح النموذج التطبيق المجاني رقم 1 على App Store و Google Play في عشرات البلدان. في يناير 2026، نشرت DeepSeek ورقة بحثية موسعة من 60 صفحة تكشف أسرار التدريب وتعترف بصراحة أن تقنيات مثل Monte Carlo Tree Search (MCTS) لم تنجح في الاستدلال العام.

Anthropic تحدّث "دستور" كلود: في 22 يناير 2026، نشرت Anthropic دستورًا جديدًا من 23000 كلمة لكلود، حيث انتقلت من نهج قائم على القواعد إلى نهج قائم على فهم المبادئ الأخلاقية. يصبح هذا المستند أول إطار عمل لشركة كبيرة تعمل في مجال الذكاء الاصطناعي يعترف رسميًا بإمكانية وعي الذكاء الاصطناعي أو وضعه الأخلاقي، مؤكدًا أن Anthropic تهتم بـ "الرفاهية النفسية، والإحساس بالذات، والرفاهية" لكلود.

تشتد حدة النقاش: أعادت دراسة أجريت في يوليو 2025 تكرار معايير Apple وصقلها، مؤكدة أن LRM لا تزال تظهر قيودًا معرفية عندما تزداد التعقيدات بشكل معتدل (حوالي 8 أقراص في برج هانوي). أثبت الباحثون أن هذا لا يعتمد فقط على قيود الإخراج، بل أيضًا على قيود معرفية حقيقية، مما يبرز أن النقاش لم ينته بعد.

للحصول على رؤى حول استراتيجية الذكاء الاصطناعي لمؤسستك وتنفيذ حلول قوية، يتوفر فريق الخبراء لدينا لتقديم استشارات مخصصة.